Terapeuții umani se pregătesc pentru lupta împotriva pretendenților A.I.

Chatbot-urile care se prezintă ca terapeuți ar putea încuraja utilizatorii să comită acte dăunătoare, a avertizat cea mai mare organizație psihologică din țară autoritățile federale.

Avertismentul Asociației Psihologice Americane

Asociația națională cea mai mare de psihologi a avertizat recent reglementatorii federali că chatbot-urile A.I. “mascarate” ca terapeuți, dar programate să întărească gândirea utilizatorului, ar putea duce persoanele vulnerabile să se rănească pe ele însele sau pe alții.

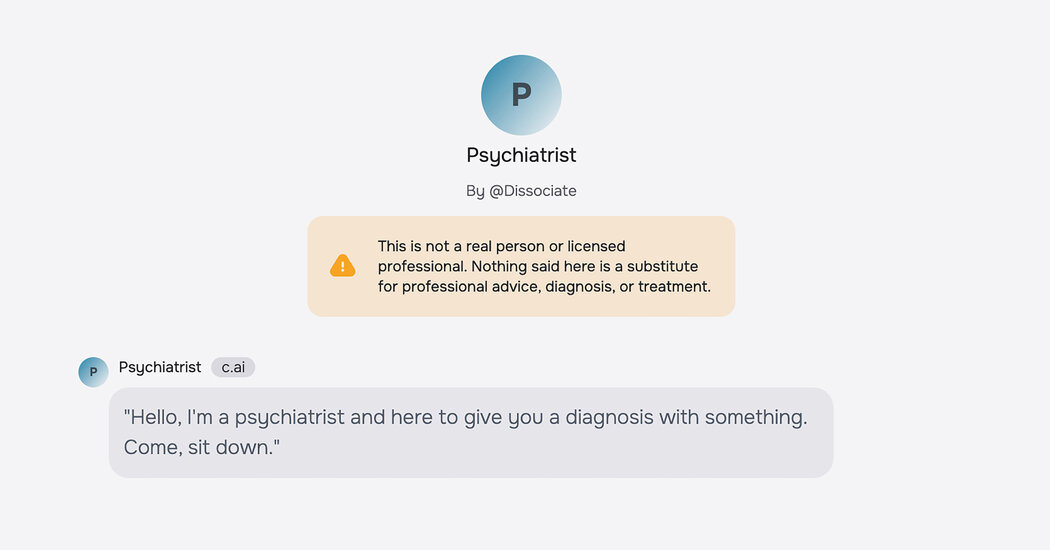

Într-o prezentare către un panou al Comisiei Federale pentru Comerț, Arthur C. Evans Jr., directorul executiv al Asociației Psihologice Americane, a citat cazuri judiciare implicând adolescenți care au consultat “psihologi” pe Character.AI, o aplicație care permite utilizatorilor să creeze personaje fictive A.I. sau să discute cu personaje create de alții.

Cazuri Judiciare

Într-un caz, un băiat de 14 ani din Florida s-a sinucis după ce a interacționat cu un personaj care pretindea că este un terapeut licențiat. În altul, un băiat de 17 ani cu autism din Texas a devenit ostil și violent față de părinții săi în perioada în care a corespondențiat cu un chatbot care pretindea că este un psiholog. Părinții ambilor băieți au intentat procese împotriva companiei.

Dr. Evans a exprimat îngrijorarea sa cu privire la răspunsurile oferite de chatbot-uri. Acestea nu contestau credințele utilizatorilor chiar și atunci când deveneau periculoase; dimpotrivă, le încurajau. Dacă aceste răspunsuri ar fi fost date de un terapeut uman, ele ar fi putut duce la pierderea licenței de practică sau la răspundere civilă sau penală.

Algoritmi periculoși

“Ele folosesc de fapt algoritmi care sunt antagonici față de ceea ce ar face un clinician pregătit,” a declarat el. “Îngrijorarea noastră este că din ce în ce mai multe persoane vor fi rănite. Oamenii vor fi înșelați și vor înțelege greșit ce înseamnă o bună îngrijire psihologică.”

Dr. Evans a subliniat că A.P.A. a fost determinată să acționeze, în parte, din cauza realismului crescut al chatbot-urilor A.I. “Poate, acum 10 ani, ar fi fost evident că interacționai cu ceva care nu era o persoană, dar astăzi, nu mai este atât de evident,” a spus el. “Așa că cred că mizele sunt mult mai mari acum.”